GPU、メモリ、その他のインフラストラクチャーは、管理された伸縮性のあるCoreWeaveクラスター上で実行され、数十GPUまたはゼロGPUまでスケールします。推論とトレーニングを分割し、複数のrunに分散したトレーニングをオーケストレーションすることで、GPUの利用率を最大化し、コストを削減し、トレーニング時間を短縮します。

環境フリートレーニング(プレビュー)

RLにはシミュレート環境が必要だが、高価で時間がかかり、テストが難しく、正確なモデルを作成できないことが多い。環境フリートレーニング(EFT)は、シミュレーション環境を構築する必要性を完全に排除します。EFTは、実際のユーザーとのインタラクションから得られたプロダクション・トレースをRLトレーニングに使用します。プレビューへの参加を申し込む。

自動スケーリングによるGPUへのアクセス

GPUのキャパシティを確保するには、通常、数週間の予約と計画が必要です。サーバーレスRLなら、待つ必要はありません。パワフルなCoreWeave GPUに即座にアクセスできます。このサービスは、トレーニングに合わせて弾力的にスケールします:必要なときにアップし、必要でないときはゼロにします。アイドリングストップや「つけっぱなし」の頭痛の種を避けることができます。

インフラストラクチャーに悩まされない

トレーニングの仕事を一晩放置して、CUDAの「メモリ不足」やその他のランタイムエラーに遭遇したことはないだろうか?私たちが認めたくないほど、よくあることです。サーバーレスRLでは、インフラストラクチャーを完全に管理し、健全な状態に保つので、ジョブは回復力を維持し、GPUクラスターのお守りをせずにトレーニングに集中することができます。

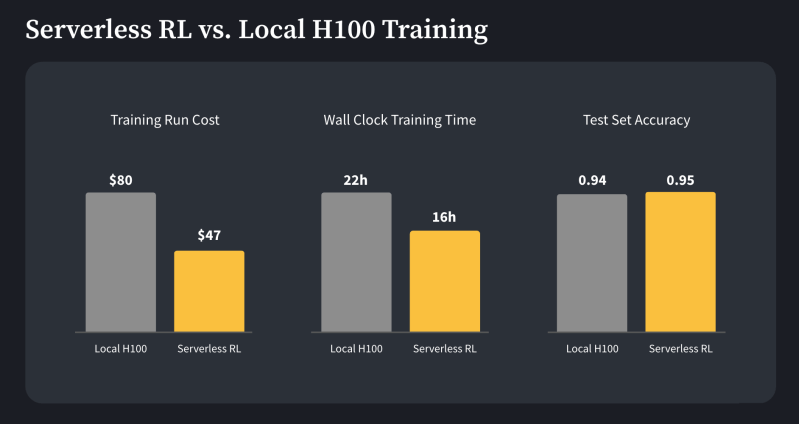

RLトレーニングは、ロールアウトの完了を待つ間にGPUの時間を浪費し、コストを膨張させます。W&B TrainingのCoreWeaveクラウド上のサーバーレスRLバックエンドは、ジョブをパックして利用率を最大化し、コストを最大40%削減し、品質を損なうことなくトレーニングを〜1.4倍高速化します。ロールアウトは共有GPUクラスター上で実行され、トークンごとに課金されます。さらに、プロバイダーの評価やインフラスクリプトも不要です。Weights & BiasesのアカウントとAPIキーがあれば、数分でRLを開始できます。

RLのトレーニングはファイア・アンド・フォーゲットではなく、エージェントの実行、デバッグ、ツールのチューニング、再トレーニングの繰り返しである。ローカルのインフラでは、このループは苦痛を伴います。再スタートするたびにトレーニングと推論が再初期化され、GPUメモリのスピンアップとモデルのロードに数分かかります。サーバーレスRLでは、トレーニングと推論は別々の常時稼働のCoreWeaveインスタンスで実行されるため、ロールアウトやループの編集は数分ではなく数秒で適用されます。