LLM 運用を最適化し、迅速なエンジニアリングを実現します。

Weights & Biases

主要な ML チームがエンドツーエンドの LLM 運用のトレーニング、追跡、調整、管理に W&B プラットフォームを利用している理由をご覧ください。

によって信頼されています 最先端の LLM を構築するチーム

データ責任者

「クラウド プロバイダーの課題は、ターミナルの出力を解析しようとしていることです。プロンプトで私が本当に気に入っているのは、エラーが発生したときに、チェーンのどのステップが壊れたのか、そしてその理由がわかることです。これを出力から取り出そうとしているのです」クラウドプロバイダーとの契約はとても面倒です。」

製品担当副社長 – OpenAI

「私たちはほぼすべてのモデルトレーニングに W&B を使用しています。」

プロダクト マネージャー – Cohere

「W&B では、すべての候補モデルを一度に検討できます。 これは、各顧客にとってどのモデルが最適であるかを理解するために不可欠です。 報告書には、 [also] 私たちにとって素晴らしかったです。 これにより、技術者以外のチームでも理解しやすい方法で、微妙な技術情報をシームレスに伝達できるようになります。」

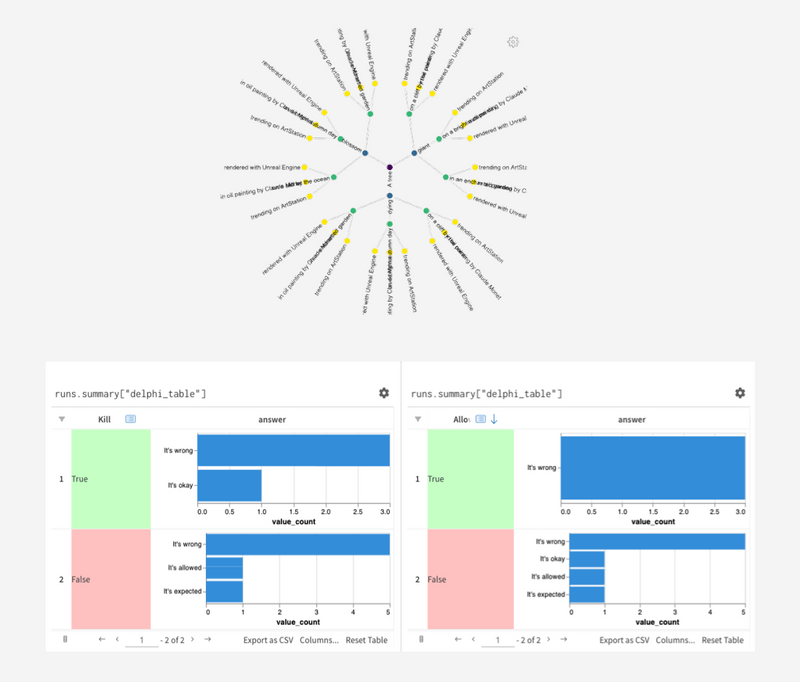

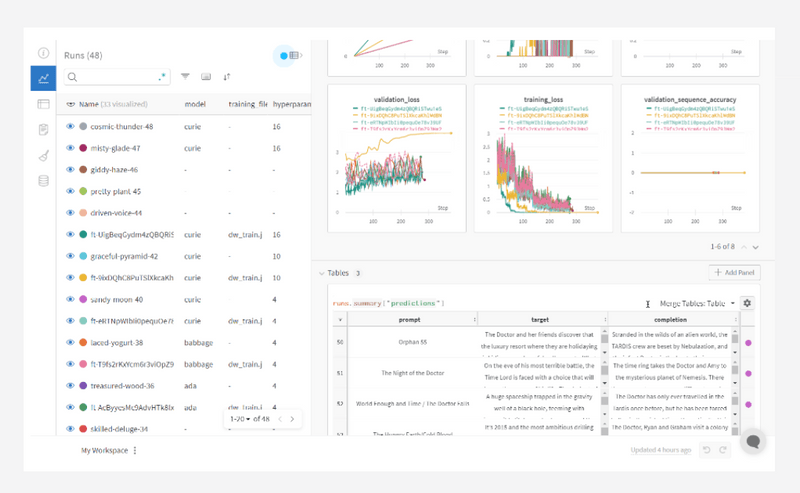

視覚的に迅速なエンジニアリングを改善 インタラクティブな評価ループ

W&B テーブルを使用してテキスト プロンプトを複雑さと言語的類似性に基づいて整理し、視覚的にインタラクティブな評価ループを有効にし、特定の問題に対する最適なアプローチをより深く理解できるようにします。

例

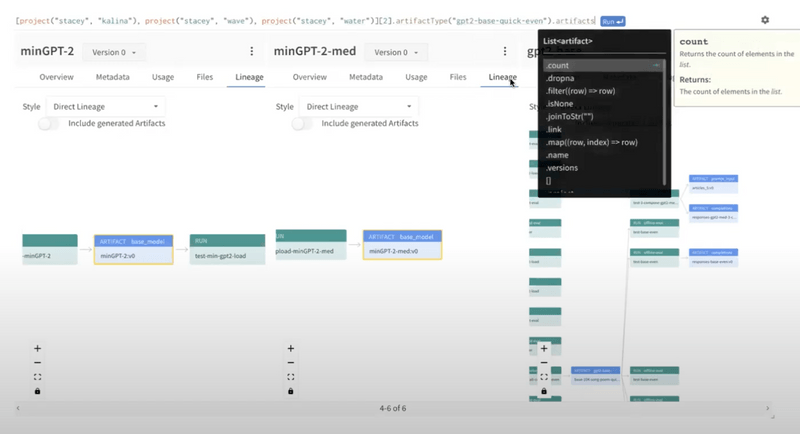

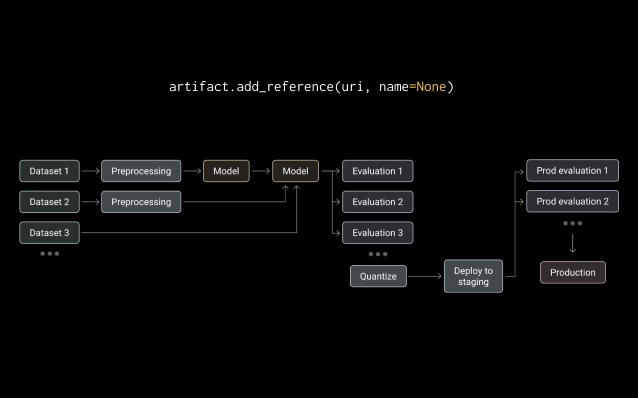

すべてを追跡してください データセットとモデルのバージョン管理

LLM パイプラインの各ステップと、W&B アーティファクトを使用したプロンプト テンプレートの違いを保存、バージョン管理し、表示します。 時間の経過に伴うデータの進化を段階的に追跡し、最高のパフォーマンスを発揮するモデルのチェックポイントを保存します。 カスタムのローカル埋め込みとエンタープライズレベルのデータアクセス制御を使用して、プライベートデータと機密データを規制、監視、保存します。

学ぶ

LLM を微調整する 自分のデータを使って

OpenAI、Cohere、またはその他の言語モデルの最先端の LLM 上に構築され、Langchain の視覚化やデバッグなど、合理化された微調整ワークフローのサポートが提供されます。 エッジケースを分析し、回帰を強調表示し、W&B スイープを使用して独自のデータでハイパーパラメータをプルーニングし、より良い結果をより迅速に提供します。

例

コンピューティング リソースを最大限に効率的に使用し、 インフラ環境

W&B Launch を使用すると、コンピューティング クラスターにアクセスするためのターゲット環境にジョブを簡単に送信できるため、MLOps チームは、管理している高価なリソースを LLM トレーニングに効率的に最大化するための簡単な手段を得ることができます。

さまざまな役割を可視化することで、チームはモデルのパフォーマンスを GPU と計算リソースの使用量と簡単に関連付けることができます。

学ぶ

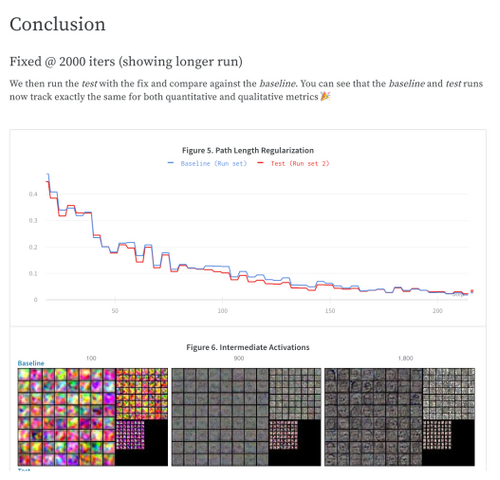

シームレスにコラボレーションする リアルタイムで

W&B の共同インターフェイスとワークフローは、シームレスなチームワークを確保し、結果やフィードバックを簡単に共有できるように構築されています。 テキスト生成に取り組む迅速なエンジニアは、W&B レポートを使用してモデルを最適化する ML 実践者に最新の更新を迅速に渡すことができます。 すべての結果を追跡し、1 つの統合された記録システム内で次のステップを計画します。

例

W&B の動作を確認する

OrchestrAI の紹介: プロンプト チェーンを使用したカスタム自律エージェントの構築

プロンプトエンジニアリングの芸術と科学

LLM を微調整する方法 パート 1: 命令チューニング用のデータセットの準備

人間のフィードバックからの強化学習を使用した LLM のトレーニング

LangChain と W&B を使用したプロンプト エンジニアリング LLM

LLM の評価

LLM のデータの処理

CohereがW&Bの助けを借りてビジネスクリティカルなLLMをトレーニングする方法

Weights & Biases プラットフォームは、

ワークフローをEnd-to-Endで効率化します

W&B Models

Experiments

ML実験のトラッキング

と可視化

Sweeps

ハイパーパラメータの

最適化

Registry

モデルとデータセット

の共有と公開

Automations

ワークフローの

自動トリガー

Launch

MLワークフローを

パッケージ化して実行

W&B Weave

Traces

LLMとプロンプトの

記録とトラッキング

Evaluations

生成AIアプリケーション

の評価