SDK

ML 모델 데이터셋 게시 및 공유

레지스트리는 버전 관리, 별칭, 트랙킹, 모델 및 데이터셋의 거버넌스를 저장하고 제공하는 선별된 중앙 저장소입니다.

import wandb

# 1. Start a W&B run

run = wandb.init(project="my_first_project")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

# 3. Log metrics to visualize performance over time

for i in range(10):

run.log({"loss": 2**-i})

Performance at scale

개발부터 준비, 생산까지 모든 단계에서 ML 모델과 데이터셋을 원활하게 관리하세요.

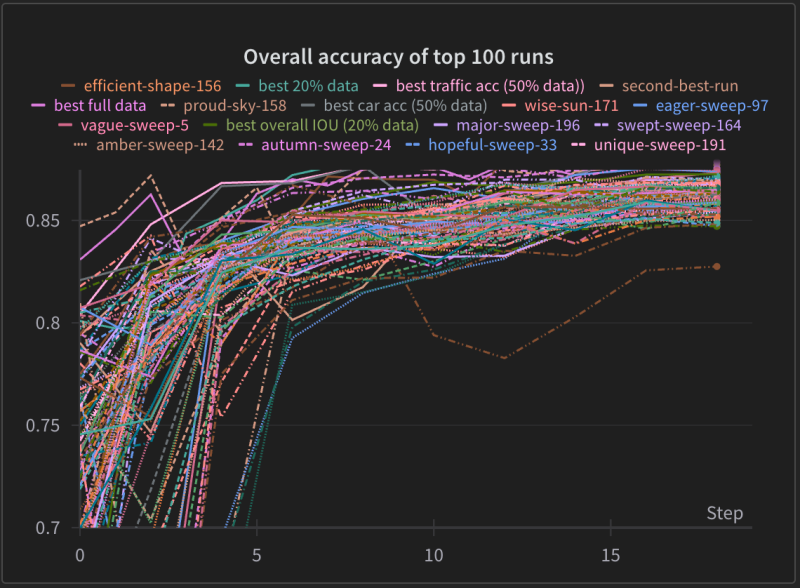

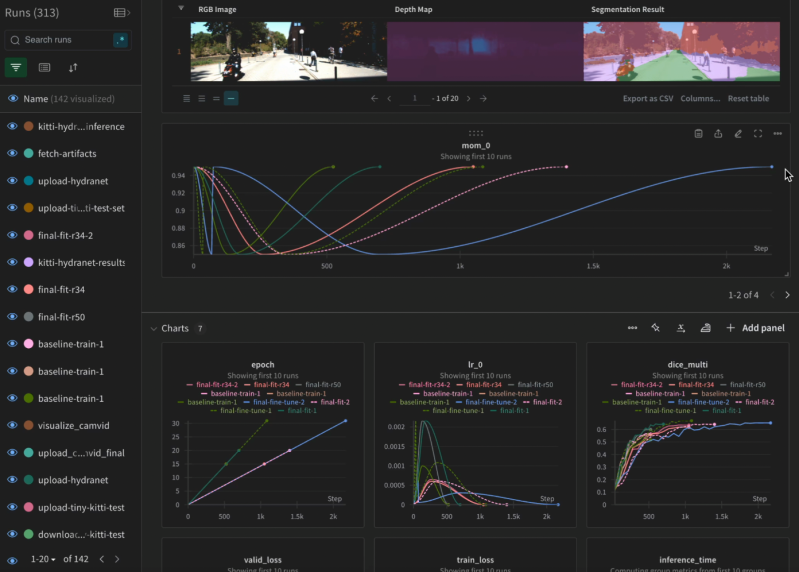

Experimentation in the era of generative AI models

large-scale 및 long-running 실험을 로컬 머신이나 대규모 분산 인프라에서 방대한 데이터 로깅과 함께 실행하세요. 첨단 AI 규모에서 대형 모델 파일을 빠르게 업로드하고 다운로드할 수 있습니다.

import wandb

# 1. Start a W&B run

run = wandb.init(project="my_first_project")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

# 3. Log metrics to visualize performance over time

for i in range(10):

run.log({"loss": 2**-i})

import weave

from langchain_core.prompts import PromptTemplate

from langchain_openai import ChatOpenAI

# Initialize Weave with your project name

weave.init("langchain_demo")

llm = ChatOpenAI()

prompt = PromptTemplate.from_template("1 + {number} = ")

llm_chain = prompt | llm

output = llm_chain.invoke({"number": 2})

print(output)

import weave

from llama_index.core.chat_engine import SimpleChatEngine

# Initialize Weave with your project name

weave.init("llamaindex_demo")

chat_engine = SimpleChatEngine.from_defaults()

response = chat_engine.chat(

"Say something profound and romantic about fourth of July"

)

print(response)

import wandb

# 1. Start a new run

run = wandb.init(project="gpt5")

# 2. Save model inputs and hyperparameters

config = run.config

config.dropout = 0.01

# 3. Log gradients and model parameters

run.watch(model)

for batch_idx, (data, target) in enumerate(train_loader):

...

if batch_idx % args.log_interval == 0:

# 4. Log metrics to visualize performance

run.log({"loss": loss})

import wandb

# 1. Define which wandb project to log to and name your run

run = wandb.init(project="gpt-5",

run_name="gpt-5-base-high-lr")

# 2. Add wandb in your `TrainingArguments`

args = TrainingArguments(..., report_to="wandb")

# 3. W&B logging will begin automatically when your start training your Trainer

trainer = Trainer(..., args=args)

trainer.train()

from lightning.pytorch.loggers import WandbLogger

# initialise the logger

wandb_logger = WandbLogger(project="llama-4-fine-tune")

# add configs such as batch size etc to the wandb config

wandb_logger.experiment.config["batch_size"] = batch_size

# pass wandb_logger to the Trainer

trainer = Trainer(..., logger=wandb_logger)

# train the model

trainer.fit(...)

import wandb

# 1. Start a new run

run = wandb.init(project="gpt4")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

# Model training here

# 3. Log metrics to visualize performance over time

with tf.Session() as sess:

# ...

wandb.tensorflow.log(tf.summary.merge_all())

import wandb

from wandb.keras import (

WandbMetricsLogger,

WandbModelCheckpoint,

)

# 1. Start a new run

run = wandb.init(project="gpt-4")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

... # Define a model

# 3. Log layer dimensions and metrics

wandb_callbacks = [

WandbMetricsLogger(log_freq=5),

WandbModelCheckpoint("models"),

]

model.fit(

X_train, y_train, validation_data=(X_test, y_test),

callbacks=wandb_callbacks,

)

import wandb

wandb.init(project="visualize-sklearn")

# Model training here

# Log classifier visualizations

wandb.sklearn.plot_classifier(clf, X_train, X_test, y_train, y_test, y_pred, y_probas, labels,

model_name="SVC", feature_names=None)

# Log regression visualizations

wandb.sklearn.plot_regressor(reg, X_train, X_test, y_train, y_test, model_name="Ridge")

# Log clustering visualizations

wandb.sklearn.plot_clusterer(kmeans, X_train, cluster_labels, labels=None, model_name="KMeans")

import wandb

from wandb.xgboost import wandb_callback

# 1. Start a new run

run = wandb.init(project="visualize-models")

# 2. Add the callback

bst = xgboost.train(param, xg_train, num_round, watchlist, callbacks=[wandb_callback()])

# Get predictions

pred = bst.predict(xg_test)

Built-in integrations

프로덕션 중인 모델에 대한 단일 정보 소스인 Registry는 재현, 재교육, 평가 및 배포를 위한 올바른 모델을 식별하여 효과적인 CI/CD 파이프라인을 위한 기반을 제공합니다.

Extensive system metrics tracking

여러 팀의 모델과 데이터셋을 보호하세요. 사용자가 필요한 아티팩트에 대한 올바른 액세스 권한을 갖고 있는지 확인하세요.

Learn what you can track

Data reliability

W&B SDK는 메모리와 컴퓨팅 리소스 경쟁이 높은 상황을 처리하도록 설계되었습니다. 이는 시스템 충돌 가능성을 줄이고 일관된 운영을 보장합니다. W&B SDK는 시스템 오류나 네트워크 문제 발생 시 데이터 손실을 방지하기 위한 중복 제어 기능을 제공합니다.

Easy customization

어떤 개발 환경과 기술 스택에도 적응할 수 있도록 설계된 W&B SDK는 필요한 대로 ML 워크플로우를 맞춤화할 수 있는 유연성을 제공합니다. 스크립트에 몇 줄의 코드만 추가하면 스칼라, 테이블부터 이미지, 오디오, 코드, 파일에 이르기까지 다양한 데이터를 기록할 수 있습니다. 경량 SDK는 모든 Python 스크립트와 함께 작동합니다.