AI is easy to productionize

The AI developer platform to train and fine-tune your AI models and develop your AI applications with confidence

W&B Weave: Develop GenAI applications

import weave

weave.init("quickstart")

@weave.op()

def llm_app(prompt):

pass # Track LLM calls, document retrieval, agent steps

W&B Models: Train and productionize models

import wandb

run = wandb.init(project="my-model-training-project")

run.config = {"epochs": 1337, "learning_rate": 3e-4}

run.log({"metric": 42})

my_model_artifact = run.log_artifact("./my_model.pt", type="model")

세계 최고의 AI 팀이 Weights & Biases를 신뢰하고 있습니다

빠르게 인터그레이션 하고, 추적 및 버전 관리를 자동화하세요

- 단 5줄의 코드를 통한 추적, 버전 관리 및 시각화

- 모든 모델 체크포인트의 재현

- CPU 및 GPU 사용량의 실시간 모니터링

“이전보다 50배 또는 100배 더 많은 ML 실험을 진행하고 있습니다.”

Phil Brown, Director of Applications

Graphcore

import wandb

# 1. Start a W&B run

run = wandb.init(project="my_first_project")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

# 3. Log metrics to visualize performance over time

for i in range(10):

run.log({"loss": 2**-i})

import weave

from langchain_core.prompts import PromptTemplate

from langchain_openai import ChatOpenAI

# Initialize Weave with your project name

weave.init("langchain_demo")

llm = ChatOpenAI()

prompt = PromptTemplate.from_template("1 + {number} = ")

llm_chain = prompt | llm

output = llm_chain.invoke({"number": 2})

print(output)

import weave

from llama_index.core.chat_engine import SimpleChatEngine

# Initialize Weave with your project name

weave.init("llamaindex_demo")

chat_engine = SimpleChatEngine.from_defaults()

response = chat_engine.chat(

"Say something profound and romantic about fourth of July"

)

print(response)

import wandb

# 1. Start a new run

run = wandb.init(project="gpt5")

# 2. Save model inputs and hyperparameters

config = run.config

config.dropout = 0.01

# 3. Log gradients and model parameters

run.watch(model)

for batch_idx, (data, target) in enumerate(train_loader):

...

if batch_idx % args.log_interval == 0:

# 4. Log metrics to visualize performance

run.log({"loss": loss})

import wandb

# 1. Define which wandb project to log to and name your run

run = wandb.init(project="gpt-5",

run_name="gpt-5-base-high-lr")

# 2. Add wandb in your `TrainingArguments`

args = TrainingArguments(..., report_to="wandb")

# 3. W&B logging will begin automatically when your start training your Trainer

trainer = Trainer(..., args=args)

trainer.train()

from lightning.pytorch.loggers import WandbLogger

# initialise the logger

wandb_logger = WandbLogger(project="llama-4-fine-tune")

# add configs such as batch size etc to the wandb config

wandb_logger.experiment.config["batch_size"] = batch_size

# pass wandb_logger to the Trainer

trainer = Trainer(..., logger=wandb_logger)

# train the model

trainer.fit(...)

import wandb

# 1. Start a new run

run = wandb.init(project="gpt4")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

# Model training here

# 3. Log metrics to visualize performance over time

with tf.Session() as sess:

# ...

wandb.tensorflow.log(tf.summary.merge_all())

import wandb

from wandb.keras import (

WandbMetricsLogger,

WandbModelCheckpoint,

)

# 1. Start a new run

run = wandb.init(project="gpt-4")

# 2. Save model inputs and hyperparameters

config = wandb.config

config.learning_rate = 0.01

... # Define a model

# 3. Log layer dimensions and metrics

wandb_callbacks = [

WandbMetricsLogger(log_freq=5),

WandbModelCheckpoint("models"),

]

model.fit(

X_train, y_train, validation_data=(X_test, y_test),

callbacks=wandb_callbacks,

)

import wandb

wandb.init(project="visualize-sklearn")

# Model training here

# Log classifier visualizations

wandb.sklearn.plot_classifier(clf, X_train, X_test, y_train, y_test, y_pred, y_probas, labels,

model_name="SVC", feature_names=None)

# Log regression visualizations

wandb.sklearn.plot_regressor(reg, X_train, X_test, y_train, y_test, model_name="Ridge")

# Log clustering visualizations

wandb.sklearn.plot_clusterer(kmeans, X_train, cluster_labels, labels=None, model_name="KMeans")

import wandb

from wandb.xgboost import wandb_callback

# 1. Start a new run

run = wandb.init(project="visualize-models")

# 2. Add the callback

bst = xgboost.train(param, xg_train, num_round, watchlist, callbacks=[wandb_callback()])

# Get predictions

pred = bst.predict(xg_test)

팀 전체에 가치를 제공하는 최고의 AI 개발자 플랫폼

FOR ML PRACTITIONERS

중복 작업을 사라지게 하는 사용자 경험

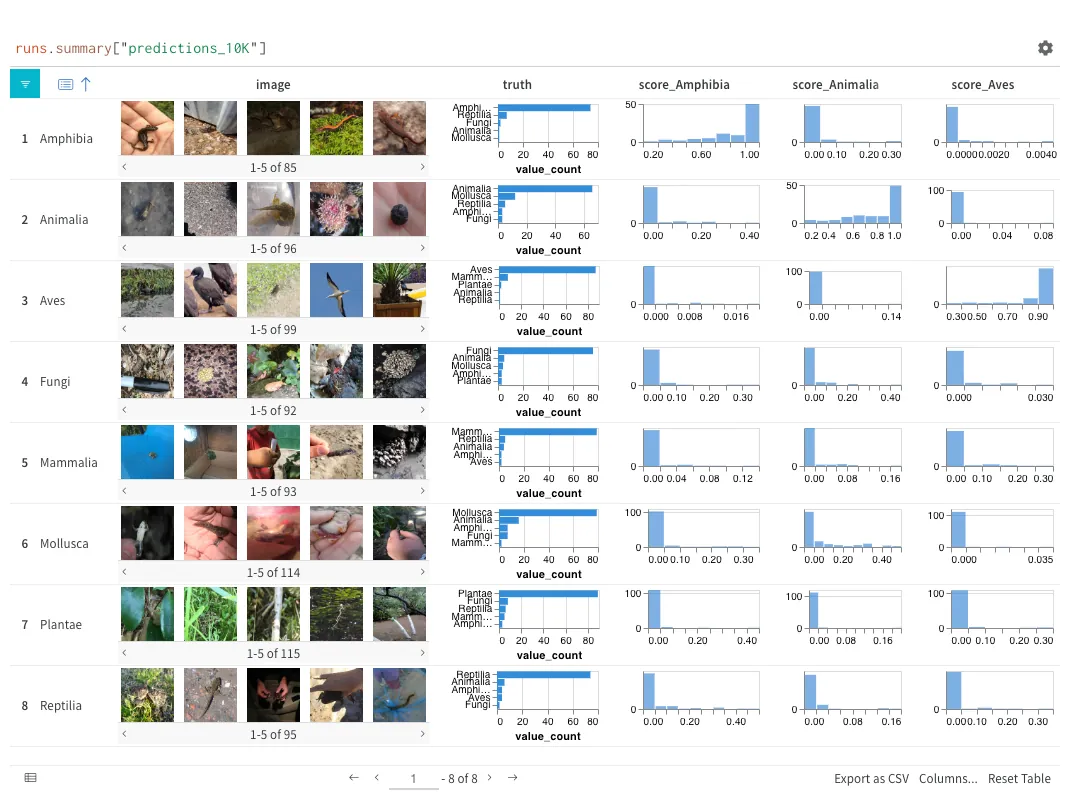

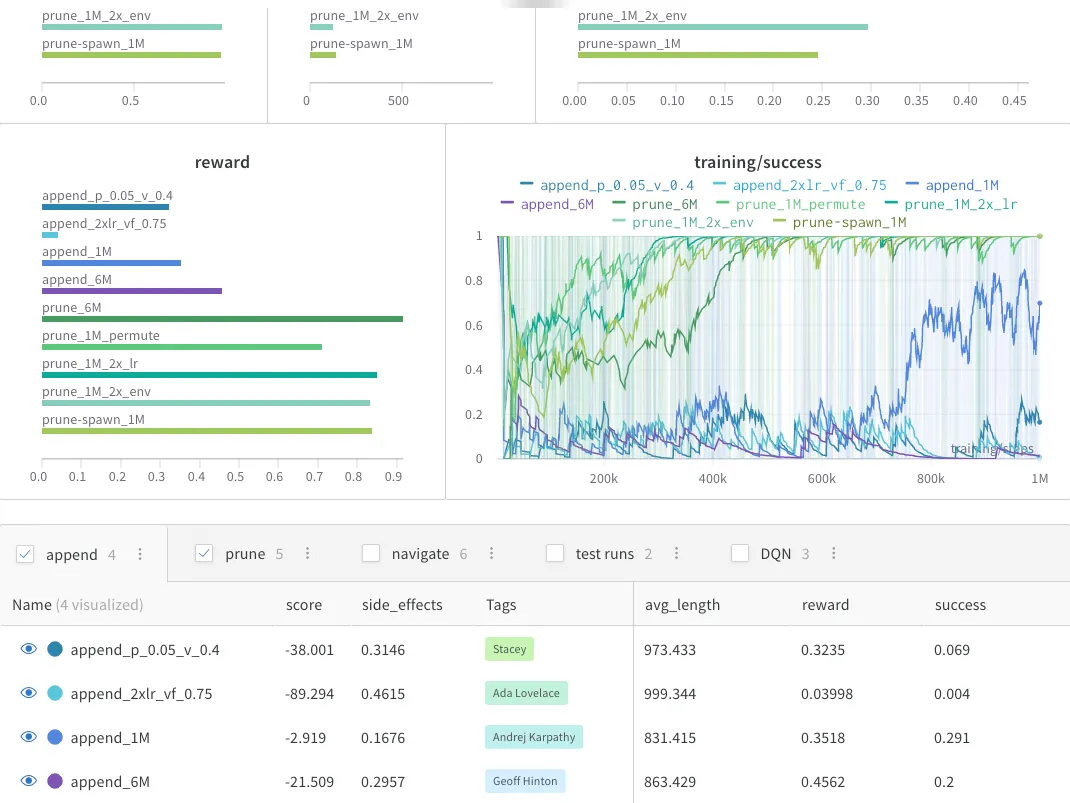

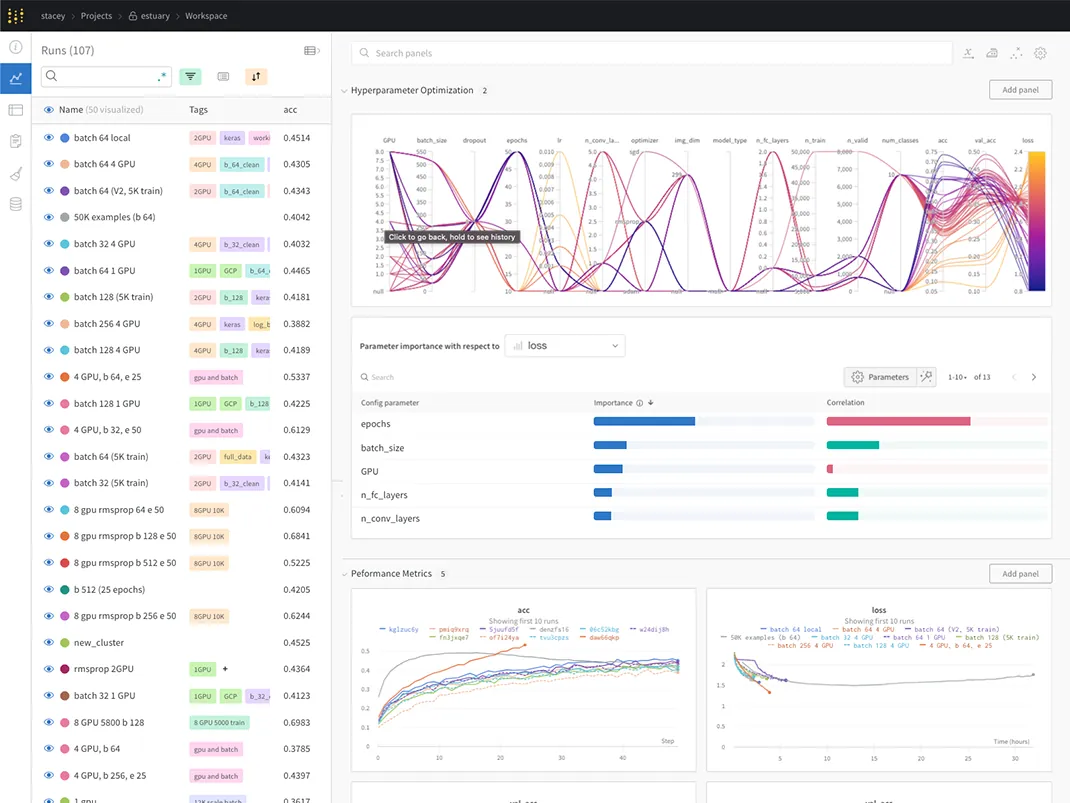

ML 파이프라인의 모든 세부 사항을 자동으로 추적하세요. 관련 컨텍스트와 함께 결과를 시각화하세요. 드래그 앤 드롭 분석으로 인사이트 발견 – 몇 번의 클릭만으로 차선책 모델을 찾을 수 있습니다.

FOR ML PRACTITIONERS

ML 엔지니어와 함께 설계한 ML 워크플로우

간소화된 ML 워크플로우를 점진적으로 구축하세요. 모든 단계를 구성하고 사용자 지정하세요. 지능형 기본값을 활용하여 처음부터 다시 시작할 필요가 없습니다.

FOR ML PRACTITIONERS

모든 이력을 재현하고 검색할 수 있는 기록 시스템

모든 실험을 즉시 재현하세요. 변경 사항을 캡쳐하며 모델 진화를 추적하세요. 팀의 작업을 쉽게 찾아보고 그곳에서 이어 구축하세요.

FOR ML LEADERS

중복 작업을 사라지게 하는 사용자 경험

ML 파이프라인의 모든 세부 사항을 자동으로 추적하세요. 관련 컨텍스트와 함께 결과를 시각화하세요. 드래그 앤 드롭 분석으로 인사이트 발견 – 몇 번의 클릭만으로 차선책 모델을 찾을 수 있습니다.

FOR ML LEADERS

어떤 산업 어떤 유스케이스라도

다양한 산업 분야의 고객들이 다양한 ML 사용 사례로 W&B를 신뢰하고 있습니다. 자율 주행 차량에서 신약 개발, 고객 지원 자동화에서 생성형 AI에 이르기까지 W&B의 유연한 워크플로우는 고객의 모든 맞춤형 요구 사항을 처리합니다.

FOR ML LEADERS

팀이 부가가치 활동에 집중할 수 있도록 지원합니다

핵심 ML 활동에만 집중 – 재현성, 감사 가능성, 인프라 관리, 보안 및 거버넌스 등 지루한 작업은 W&B가 자동으로 처리합니다.

미래 지향적인 ML 워크플로우 – W&B는 OpenAI 및 다른 이노베이터와 공동 설계하여 그들의 비법을 인코딩하므로, 처음부터 다시 시작할 필요가 없습니다.

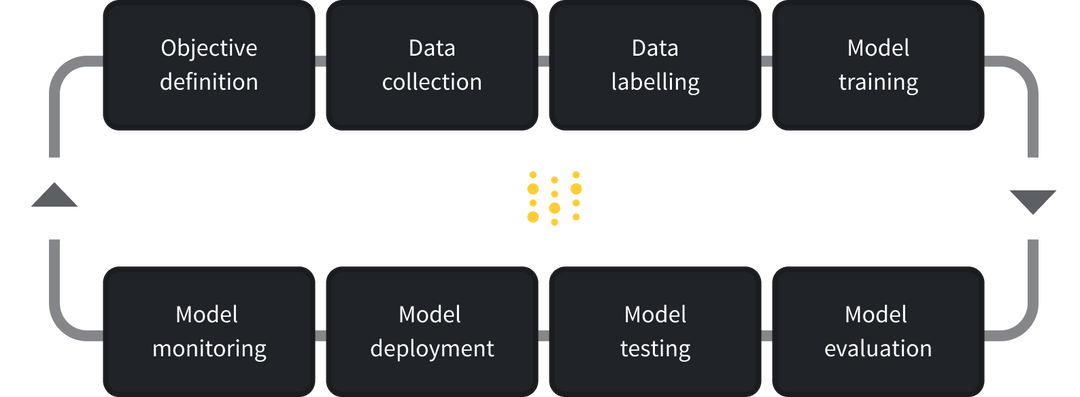

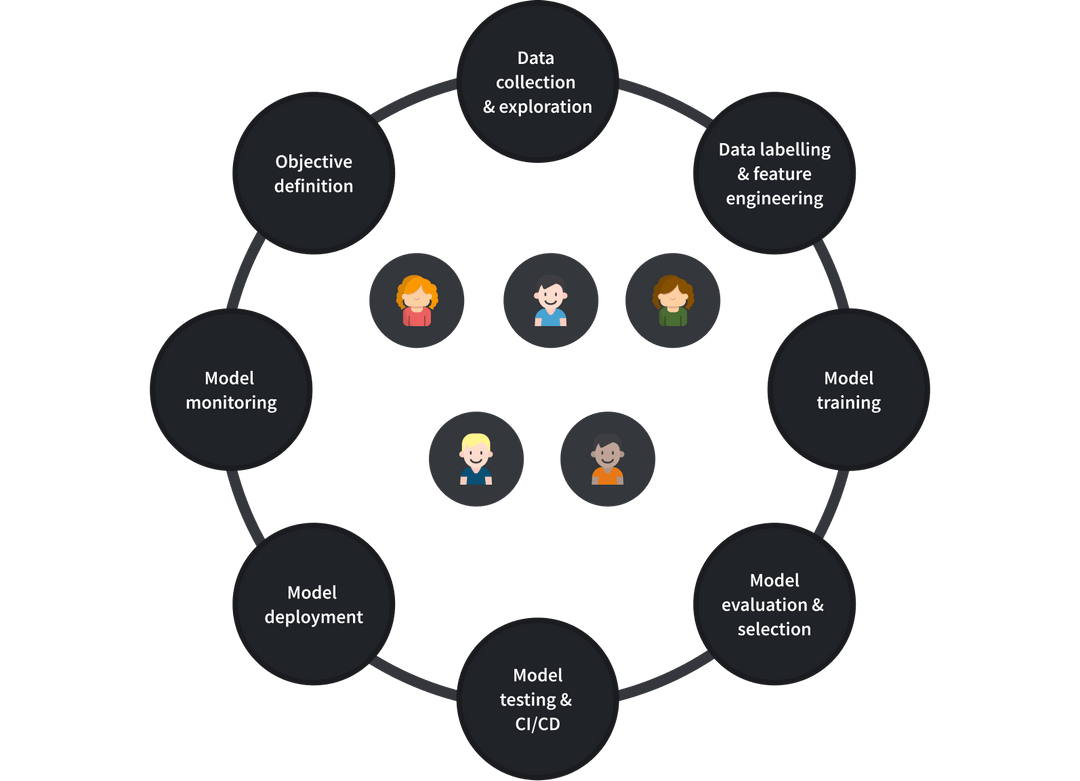

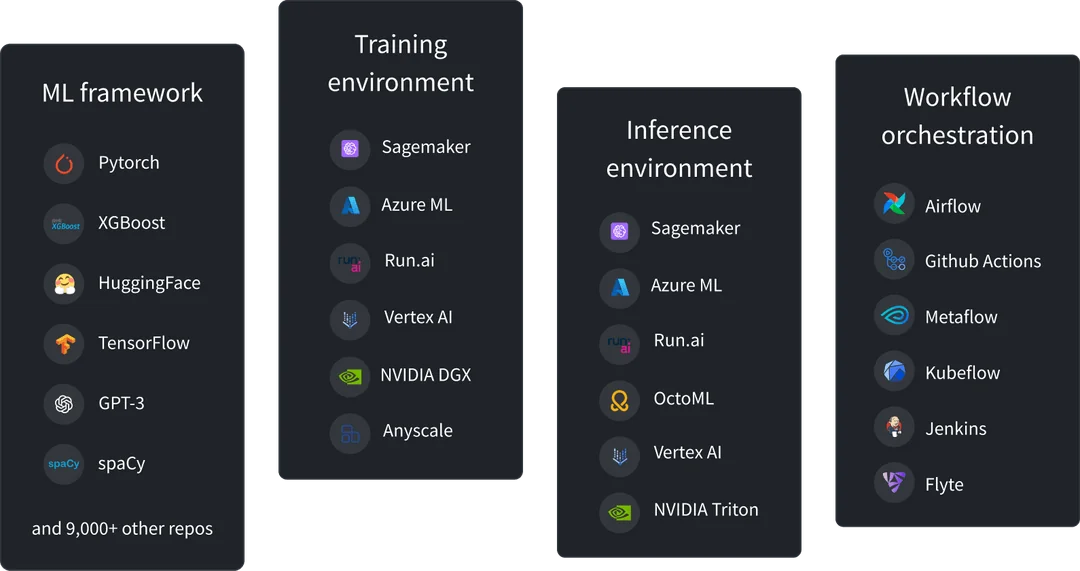

FOR MLOps

유연한 구축, 간편한 인터그레이션

W&B 관리형 또는 자체 관리형 중 원하는 인프라에 W&B를 구축할 수 있습니다. 공급업체에 종속되는일 없이 ML 스택 및 도구와 쉽게 인터그레이션할 수 있습니다.

FOR MLOps

ML 실무자와 MLOps의 연결다리

하나의 협업 인터페이스에서 ML 워크로드 자동화 및 확장 – ML 실무자는 단순성을, MLOps는 가시성을 확보할 수 있습니다.

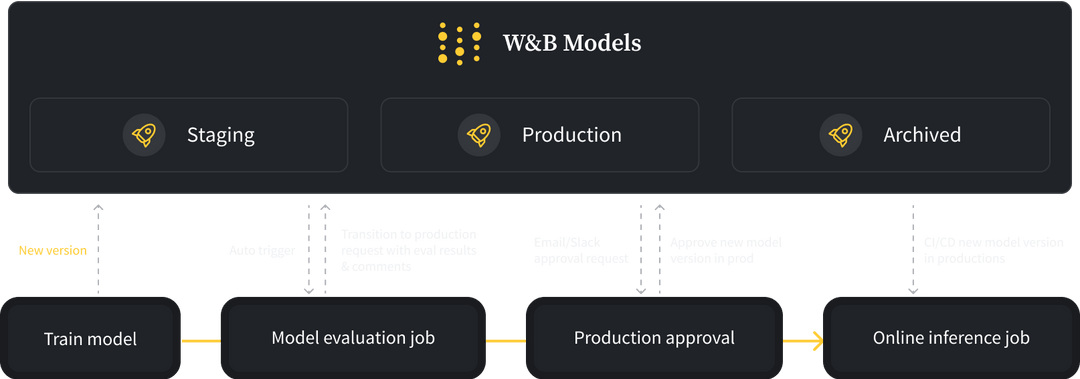

FOR MLOps

거버넌스를 통한 ML 프로덕션 확장

모든 ML 프로젝트를 위한 중앙 집중식 기록 시스템. 모델 수명 주기 및 CI/CD를 관리하여 프로덕션을 가속화하세요. 모델 진화를 이해하고 비즈니스에 미치는 영향을 경영진에게 설명하세요.

FOR GENERATIVE AI SOFTWARE DEVELOPERS

소프트웨어 개발자가 안심하고 GenAI 애플리케이션을 배포할 수 있도록 설계되었습니다.

개발자가 동적, 비결정적 대규모 언어 모델을 평가, 이해 및 반복하는 데 필요한 도구입니다.

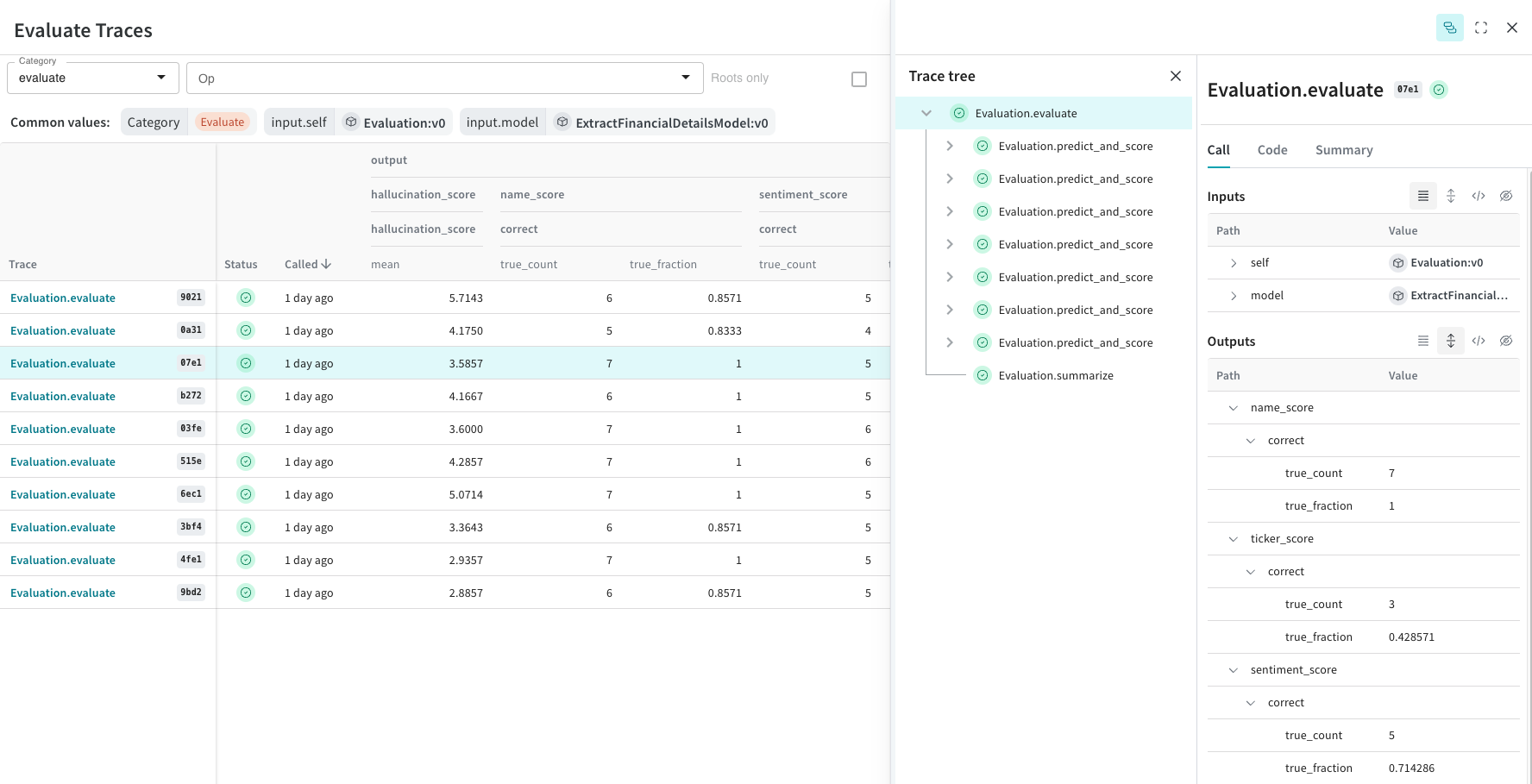

FOR GENERATIVE AI SOFTWARE DEVELOPERS

간단한 디버깅이 가능하도록 모든 입력, 출력 및 추적을 자동으로 기록합니다.

Weave는 모든 입력 및 출력 데이터를 캡처하고 트리를 구축하여 개발자가 애플리케이션에서 데이터가 어떻게 흐르는지 완벽하게 관찰하고 이해할 수 있도록 합니다.

FOR GENERATIVE AI SOFTWARE DEVELOPERS

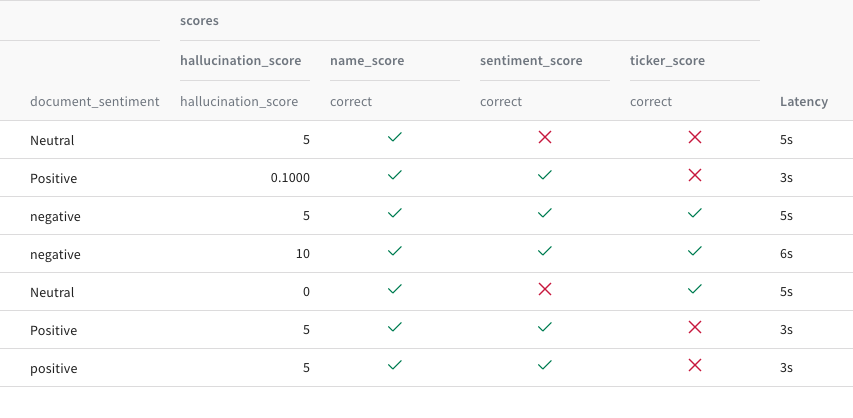

강력한 LLM 성능을 제공하기 위한 엄격한 평가 프레임워크

모델 결과에 대한 다양한 평가를 성능의 다양한 관점에서 비교하여 프로덕션 환경에 배포할 때 애플리케이션이 최대한 견고하도록 도와줍니다.